GPT-3とは

GPT-3は、2020年7月にOpenAIが発表した高性能な言語モデル。OpenAIは、Transformerと呼ばれる深層学習の手法を用いた言語モデルGPT(2018年)、GPT-2(2019年)を発表しており、GPT-3はその後継の言語モデルとなる。2021年10月時点では、マイクロソフトのクラウドサービスAzureからAPI(申請制)を介して利用でき、文章の生成、文章の要約、質問への回答、翻訳などに活用することができる。

(読み:ジーピーティースリー)

OpenAIとは

2015年12月に再生可能エネルギー ソリューションを提供するテスラのCEOであるイーロン・マスクをはじめとする複数の投資家により設立された人工知能(AI)研究所です。OpenAIは、汎用人工知能(AGI:Artificial General Intelligence)が人類全体に利益をもたらすことを使命とし、当初非営利団体として設立されました。その後、2019年に営利企業のOpenAI LPを創設し、現在OpenAI LPとそれを管理する非営利団体OpenAI Nonprofitのハイブリッド体制で運営されています。

GPT-3 (Generative Pre-trained Transformer 3)の特徴

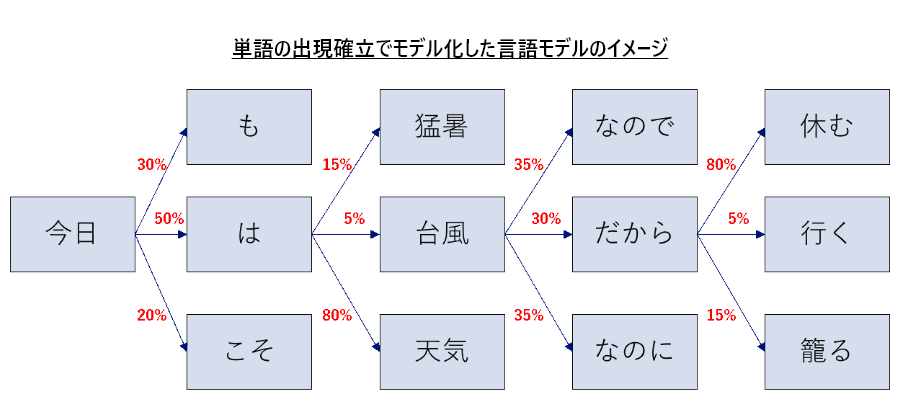

言語モデルとは、人間が話したり書いたりする言葉を単語の出現確率でモデル化したものです。一般的な言語モデルは、大量のテキストデータを使って事前に学習したベースモデルをもとに、テーマに合わせた専用の再学習(ファインチューニング)をすることで精度を高めます。しかし、この再学習には教師データ(例題と答えのデータ)を使うため、そのデータの準備に多大な労力がかかるという課題があります。これに対してGPT-3は、桁違いに膨大なテキストデータを用いて学習することで、ファインチューニングを必要としない言語モデルを作り出しています。

GPT-3は、Wikipedia やCommon Crawl(Webサイトから収集されたデータ)などから集めた45TBもの膨大なテキストデータに対し、いくつかの前処理を行った570GBのデータセットを学習に用いています。このデータセットに対して、1750億個のパラメータを持つ自己回帰型言語モデル(ある単語の次に出てくる単語を予測するモデル)を学習することで、これまでにない巨大な言語モデルを作成しています。

GPT-3の活用例

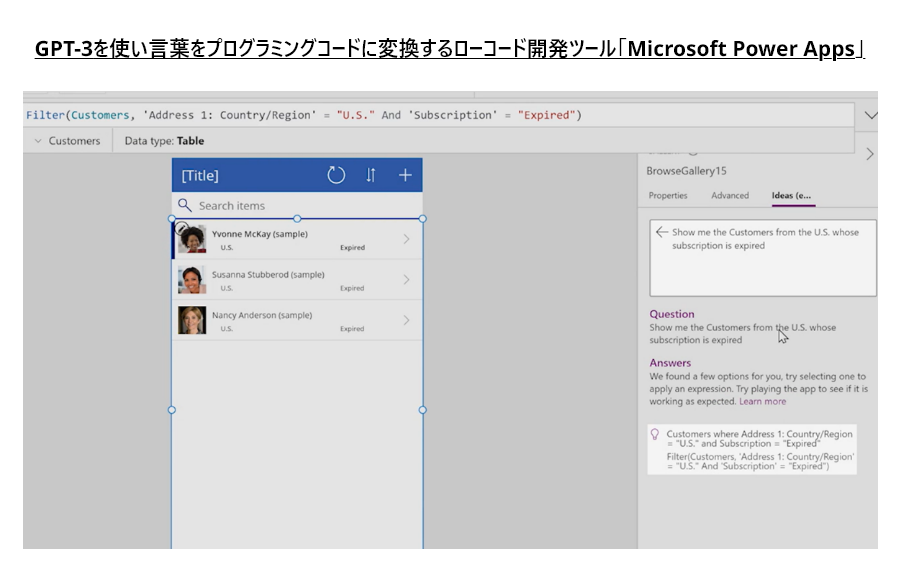

GPT-3は、2020年9月にマイクロソフトが独占ライセンスを取得し、同社のクラウドサービス「Microsoft Azure」上で利用できるAPI(申請制)として公開されています。GPT-3を活用することで、記事や小説を自動生成したり、ゲームでストーリーに沿った会話をインタラクティブに生成したり、文章でイメージを伝えるだけでアプリケーションのデザインを生成させたりすることなどができるようになります。例えば、マイクロソフトは2021年5月に、ローコード開発ツールMicrosoft Power Apps 内でGPT-3を活用することで、言葉からプログラミングコードを自動生成する機能を提供することを発表しました。

OpenAIの発表によると2021年3月時点で、GPT-3のAPIを利用した300以上のアプリケーションが開発され、1日平均で45億語を生成しているそうです。