2023/10/12

2022年11月30日にChatGPTが公開されて以降、生成AIサービスへの注目度は急速な高まりを見せており、個人はもちろんのこと、企業でも利用が検討されはじめています。一方で生成AIに潜むセキュリティリスクが表面化し、世界各国では生成AIサービスをどこまで活用し、どこまで規制するかについて議論が行われるようになりました。生成AIサービスの利用には、どのようなセキュリティリスクがあるのか。生成AIを安全に活用するには、どのようにすればよいのか。NRIセキュアテクノロジーズの山口 雅史に聞きました。

便利な一方、セキュリティリスクも潜む生成AIサービス

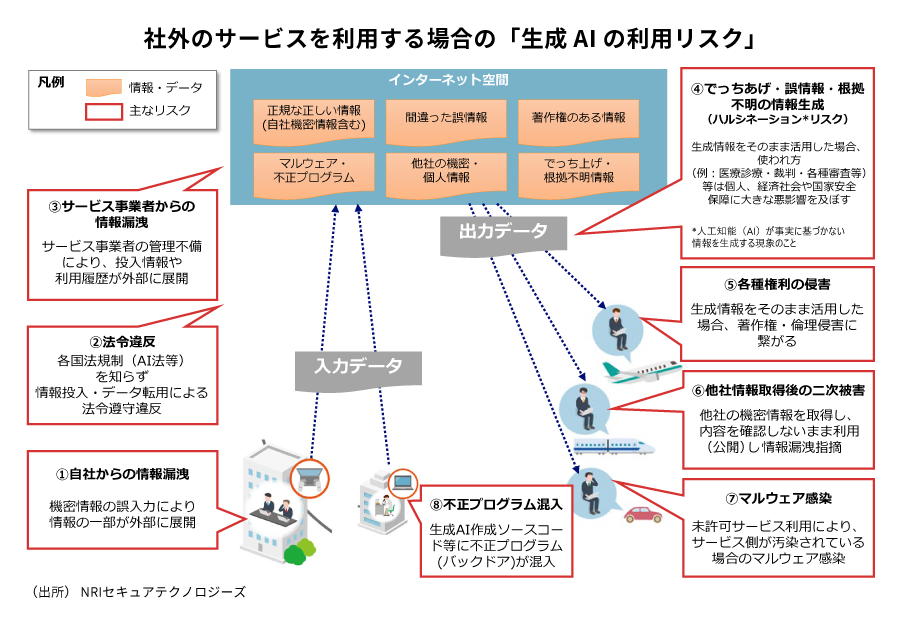

ChatGPTの世界的な流行を機に、日本の企業も生成AIの活用を模索し始めました。しかし生成AIの業務利用には、多くのリスクも存在します。その中でも最も深刻なのはセキュリティリスクです。生成AIの種別によって想定されるリスクは異なりますが、ここでは悪意ある攻撃や人為的なミスによって引き起こされる3つの主なリスクを中心に考察します。

1つめは、AIチャットボットに対する攻撃です。ChatGPTなどの生成AIサービスには、違法・非倫理的な入力への応答を拒否する仕組みが備わっています。しかし入力内容に細工をすれば、この仕組みを突破できてしまうことがわかっています。つまり、提供するサービスのAIチャットボットが攻撃を受けて、機密情報が漏えいする被害も十分に考えられるのです。

2つめは、ディープフェイクです。生成AIを使えば、リアルな画像や動画、音声を簡単に生成できます。これを悪用して偽情報をSNSで拡散する、生体認証等を偽装しなりすましにより詐欺を行うといった事件が実際に起こっています。特に詐欺行為はサイバー領域においても非常に深刻であり、米当局も生成AIのサイバー犯罪への利用を強く警戒しています。

3つめは、従業員による「うっかり漏えい」です。現時点では生成AIを組織的に活用する企業はさほど多くなく、社員へのセキュリティ教育も十分ではありません。このような中、社員が個人的に生成AIを利用し、機密情報を入力してしまう例が散見されています。入力したデータがAIの学習に取り込まれると、他者への応答に機密情報が現れてしまうリスクがあります。開発者の間では、生成AIで抽出したコードや設定ファイルをそのままデバッグや機能開発に利用してしまうケースもあり、サイバーセキュリティの観点でも危険性が高まっています。

これらのことから、企業は生成AIを自社ビジネスに適用する場合、防御の対策もあわせて検討する必要があります。自社でのセキュリティ対策の実装ではまだまだノウハウやコスト面等で限界があるため、現状では大手サービスを採用するのが無難でしょう。さらに自社ビジネスやリモートアクセスで生体認証を採用している場合は、近い将来それが突破されるリスクが高まっていることを認識しなければなりません。

進むAI法規制、新たなセキュリティ脅威も

生成AIの活用が進む中、雇用機会の奪取や安全保障、著作権の侵害などのリスクも懸念されています。こうしたリスクに対処するために作られたのが、欧州委員会による「AI法」です。AI法とは健康や安全、基本的人権などを脅かすAIのリスクに対処し、AIの導入や投資、技術革新の強化を目的とした法案です。リスクに応じて規制の内容を変える「リスクベースアプローチ」を採用し、リスクが高い分野を扱うAIサービスの利用には、特別なチェックを義務付けています。欧州委員会は、AI法の事業者向けの完全施行を2024年後半に目指しており、成立すれば包括的なAI規制法となる見込みです。

さらに2022年には、消費者が生成AIをはじめとするAIシステムで被害を受けた場合、提供元の企業に対して民事責任を規定した「製造物責任指令の改正案」、補完する特別規定を設けた「AI責任指令案」を発表しました。この2案の目的は、生成AIサービスの提供企業に安全なサービスを提供する責任を課し、システムの構築・訓練方法についての説明を義務付けることです。実質的に、先のAI法に実効力を与えるものだと言えるでしょう。規則に沿わない企業への訴訟ハードルを下げるため、消費者の立証責任を軽減し、企業への情報開示請求を容易にするための規定も設けられています。

こうした法規制に伴い、反対運動による規制やサービス側の自主規制も進みつつあります。アメリカでは大学教授やAI開発者を含む有識者1,000人超が、GPT-4に対して社会不安を引き起こす可能性を指摘し、開発を一時停止するよう求めました。また政治的・宗教的に問題があるディープフェイク画像の流行後、画像生成AI大手「Midjourney」が無料トライアルの停止を発表しました。

規制が進む一方で、新たな脅威も生まれています。ChatGPTは2023年5月にプラグイン機能を追加しました。これによって利便性が大幅に向上した反面、悪意のあるユーザーによって特定のWebサイトへの検索を誘導して攻撃を行えるなど、全く新しい脅威が生まれる可能性も出てきました。

生成AIサービスにおける攻撃と防御は“いたちごっこ”の様相を呈しており、完全に撲滅しようとするのは難しい状況ですが、セキュリティ対策としてAIを活用することもできます。セキュリティ担当者が従来務めていた作業をAIが代行し、事故発生時にどのような経路で攻撃者が侵入したのか、どのデバイスが影響を受けているのかなどをフローチャートで詳細に把握し、複数ある対処の優先度を提案してもらうことが可能になります。すでに多くのサイバーセキュリティベンダーが、生成AIの導入検討を進めており、セキュリティAIサービスの活躍を見る日は近そうです。

利用企業、提供企業の双方が責任感あるセキュリティリスク対応を

日本では今のところ生成AIサービスがおおむねポジティブに捉えられていますが、今後は諸外国の動向を踏まえて、同様の動きとなる可能性は否定できません。企業の利用事例はようやくこれから増えるという段階ですが、今後の動向には注意が必要です。まずはAIサービスの社内利用を許すかどうかを決め、許す場合は必要なルール・リテラシーの提示に向けて準備をはじめておくと安心です。

サービス利用前には、セキュリティリスクの評価も必要です。過去の被害事例を参考にしながら、そのリスクをどのように管理するかも決めておきましょう。利用ルールやセキュリティガイドラインを提示するとともに、社員や取引先に向けた情報周知・リテラシー教育も必要不可欠です。実際に導入が決まれば、入力データの保管場所や特定・削除方法の確認、作業マニュアルの作成なども求められます。継続的にAI利用に対するセキュリティ統制を図るため、利用ルールに対する定期的な監査も必要になるでしょう。

一方で生成AIサービスを提供する企業やIT・セキュリティベンダーには、各種規制法案に沿った安全対策が求められます。音声・生体認証の強化はもちろん、新しい攻撃手法についての情報収集や対策案の作成、機密情報を入力してしまった際に想定されるリスクの開示など、多岐にわたる取り組みが必要になります。入力した内容がAIの学習に利用されるのを防ぐためには、企業に対する専用APIの提供も有効です。

政府機関には、こうした企業の取り組みを後押しする枠組みの構築が求められます。国際機関や世界各国のAI関連法案を参考に、日本独自の法案・ガイドラインを設定することが必要です。同時に生成AIサービス提供企業との意見交換やサービスの評価を行うことのほか、生成AIに関する研究への助成も期待されるでしょう。

生成AIの発展はあまりにも急速であり、セキュリティ面が後追いになりがちです。しかしセキュリティリスクを放置すれば、経営を揺るがしかねない大きな事故につながります。サービスの利用企業、提供企業の双方が責任感をもってこの問題をとらえ、政府機関とも連携しながら対策を進めていくことが求められます。

専門家情報

山口 雅史

NRIセキュアテクノロジーズ株式会社

コンサルティング事業統括本部長 兼 北米支社Security Consulting Department部長

8年半ソフトウエア企業でシステムSI・運用やコンサルティングに従事。2008年に野村総合研究所に入社と同時に、NRIセキュアテクノロジーズに出向し、セキュリティソリューション開発・SIを経て、セキュリティコンサルティング業に従事。セキュリティ戦略企画や統合PMOを得意とし、数多くのセキュリティ関連プロジェクトを推進。

関連コンテンツ

専門組織だからこそできる日本全体のセキュリティレベルの底上げ / 山口 雅史|NRI People

関連記事

サプライチェーンを取り巻く脅威と、欠かせないセキュリティの視点

- 所属部署・役職などは掲載当時のものです。

- NRIジャーナルの更新情報はFacebookページでもお知らせしています