未来のビジネスシーンでは、AIと人間が協働することが当たり前となります。前回はそんな未来への備えについて「IT」の視点で説明しました。今回は、「組織」の側面を詳細に掘り下げていきます。具体的には、人材育成のあり方、リスク対策、そして意思決定プロセス変革という、AIと協働する未来の組織に必要な3つの視点に焦点を当てます。

執筆者プロフィール

関西ITコンサルティング部 西野 浩明:

2001年、NRIに入社。15年超のシステム開発経験・プロジェクトマネジメント経験を活かして、ビジネス変革・業務改革を伴うシステム上流工程(構想、計画、システム調達)、インフラ構想(クラウド活用戦略、アーキテクチャーデザイン)、システム開発時のユーザー側活動(要件定義、開発標準化、業務移行、受入テスト)および大規模システムPMOなどのITコンサルティングに従事。

AIネイティブに向けた「組織の備え」

本格的なAI時代を迎えた現在、企業の成長戦略においては、AI活用により知的労働が持続的に進化する「AIネイティブ」な状態を目指すことが重要となっています。今回は、生成AIとの協働がもたらす変化を、人材、リスク、意思決定の観点から考察し、それに対応するために企業がどのような「組織の備え」を整えるべきかについて解説します。

生成AIと協働する人材のあり方

かつて、業務のIT化が進行した時代では、PCや情報システムなどを使いこなす能力を身につけることが業務を遂行するなかで求められました。同様に、AI時代には、生成AIと協働して知的労働を進化させるための新たな能力が必要とされます。

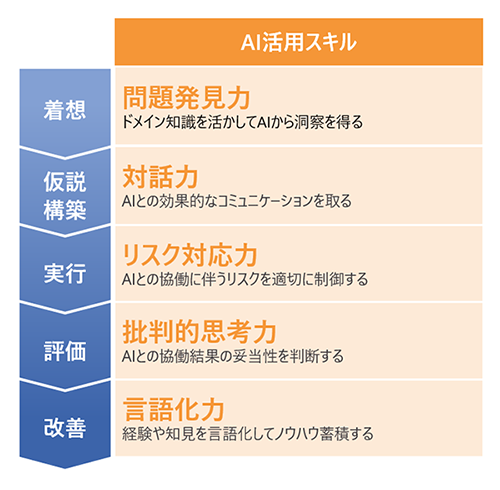

生成AIと協働するために必要な能力は、問題定義力、対話力、リスク管理力、暗黙知の言語化力、批判的思考力の5つです(図1)。

問題定義力: 生成AIは、人間の問いに対して多様な形で回答することが出来ます。知的労働において、これまでは「問いに対する解決策」を考え出す問題解決力が重要でしたが、これからは生成AIに対して的確な問いを立てる問題定義力がより重要となります。

対話力: 生成AIから最適な回答を引き出すためには、生成AIとの対話能力が必要となります。生成AIとの対話は大規模言語モデルを介して行いますので、そのモデルの特徴を理解し、効果的なプロンプトエンジニアリングを行う力が重要です。

リスク管理力: 生成AIとの協働が進むにつれて、生成AIとの対話をもとに重要な判断を行ったり、生成AIが生成したコンテンツを重要な業務で活用したりする機会が増えてくるでしょう。その際、AIとの協働に伴うリスクを正しく認識し、それを管理し、対応する能力が必要となります。AIとの協働によるリスクについては後述します。

批判的思考力: 生成AIとの協働による結果に対して最終的な責任をとるのは、生成AIを活用する我々人間です。そのため、生成AIとの協働の全工程において、生成AIとの対話の過程や生成されたコンテンツに対して、批判的な視点から妥当性を評価する能力が求められます。

暗黙知の言語化力: 前回記事ではGoodデータの重要性について述べました。Goodデータの源泉は、ビジネスの現場で培われる暗黙的な経験知やノウハウです。これらを言語化し、Goodデータとして蓄積する能力が求められます。

図1 生成AIと協働するために必要な能力

これら5つの能力を有する人材の育成を通じて、生成AIと協働する強固な「組織力」を築き上げ、企業のAIネイティブへの取り組みを加速させていくことが重要となります。

AIとの協働に伴うリスクとその対策

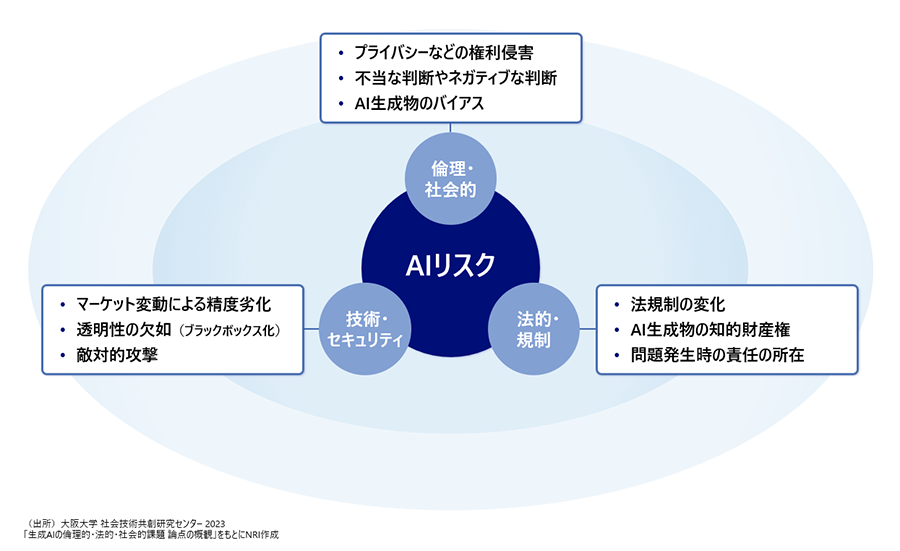

AIとの協働には多くのメリットがありますが、過去の炎上事例からも明らかなように、一定のリスクを伴います。例えば、マイクロソフトが開発したAIサービスが差別的な発言をしたという事態は、倫理的なリスクを浮き彫りにしています。また、サムスンが設備情報や会議内容などの機密情報を生成AIへ入力することで機密情報流出につながったという事態も発生しています。

これらのリスクに対処するために、企業はAIリスクを最小化するための全社的な仕組みを構築する必要があります。AI活用に伴うリスクは多岐にわたります。プライバシーなどの権利侵害や人種や性別などに対する不当な判断などの倫理・社会的リスク、AIの精度劣化やAIに対する敵対的攻撃などの技術・セキュリティリスク、AI生成物の知的財産権などの法的・規制リスクがあります。これらのAIリスクを適切に管理するためには、各企業が倫理・社会的リスク、技術・セキュリティリスク、法的・規制リスクの観点から自社にとってのリスクを具体的に洗い出して全社員へ啓発するとともに、AI活用ポリシーやガイドラインを策定・運用する仕組み作りが必要です。

図2 AIとの協働に伴うリスク

さらに、現行の法制度は生成AIの進化や社会への浸透スピードに追い付けていないため、状況変化を常に注視しておく必要があります。例えばEUでは、新たなAI規制法案が2023年6月に採決されており、その影響は日本も含めた域外にも及びます。

また、AIの倫理基準の設定がG7などの国際的な場で強く求められていますので、EUのAI規制法案は、EUのデータ保護規則であるGDPRが世界の基準となったように、今後の世界中のAI監視に関する新たな世界基準となり、他国の法制定のテンプレートになる可能性があります。

AIとの協働に伴うリスクとその対策については、自社固有のリスクの抽出、対策の策定、法規制の動向の把握など、多角的な視点で対応すること求められます。これはデジタル部門やIT部門だけの問題ではなく、法務・知財・人事・人材開発、総務などを含む組織全体で対応する必要があります。

ビジネスの意思決定と組織構造の変革

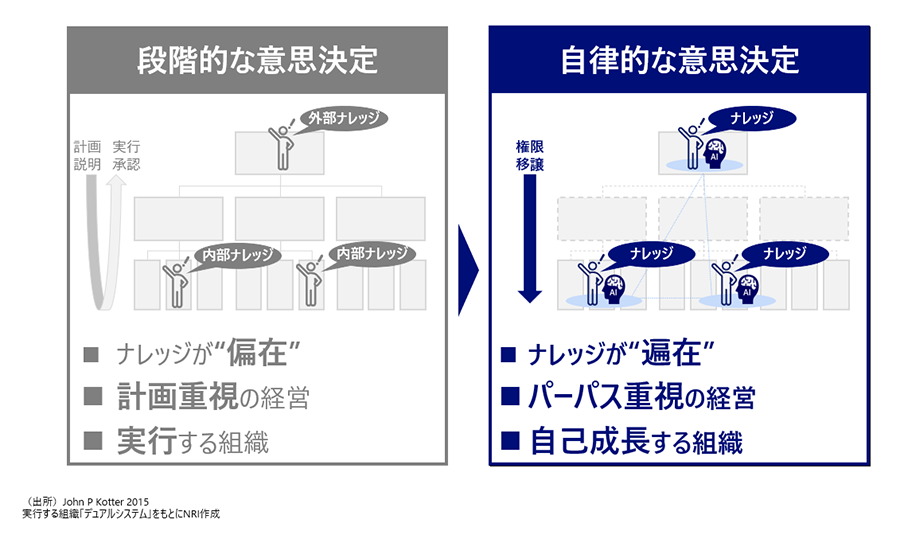

一般的に、組織のナレッジには、経営層が意思決定に用いる経験知や外部環境の変化に関する知識や、ビジネス現場が持つ業務オペレーションに関する知識があります。これらのナレッジは組織内の様々な組織や階層にわたって広く分散して存在しています。そのため、ビジネス上の意思決定を行うにあたっては、各層で個別に持っているナレッジをもとに段階的に意思決定を行うというプロセスと、それを前提とした階層型の組織が形成されてきたといえます。

今後、生成AIとの協働が加速することで、組織のナレッジの所在が変わります。具体的には、組織内に分散していたナレッジを生成AIに追加学習させることができれば、生成AIの中に集約された組織全体のナレッジを組織や階層に関わらず利用できるようになります。

このように、ナレッジが組織の中で集約されていくと、下層にあたるビジネスの現場でも的確な意思決定が可能となります。そうなると、従来の下層から上層に向かう段階的な意思決定プロセスや階層型の組織構造の必要性が薄れます。今後のビジネス環境の変化に迅速に対応するためには、現場への権限移譲をより一層進め、現場が自律的に意思決定できるプロセスや組織構造に変革していくことが重要です。

その結果、経営層の役割も変化するでしょう。戦略や計画を策定し、現場を統制・指示する従来の役割から、企業の「パーパス」を全社に浸透させる役割へと変化していくと考えられます。生成AIとの協働は、これまで度々議論されてきた意思決定プロセスや組織構造の変革の必要性を、企業全体で認識するきっかけになる可能性があります。

図3 ビジネスの意思決定と組織構造の変革

まとめ

今回は、企業がAIネイティブに進化するために必要な「組織の備え」について考察しました。生成AI活用のための能力向上、AIリスクへのガバナンス強化、そして、自律型の意思決定プロセスへの移行は、生成AIとの協働を通じて新たな未来を拓くための重要な要素となります。

今後、日本企業は労働人口の減少やベテラン社員・熟練工の退職に伴い、「日本品質」の維持が困難になる可能性があります。生成AIを人間が使う道具ではなく、人間と共に働く新たなパートナーと捉え、組織として生成AIとの協働の仕組みを構築することは、未来に向けた世代交代を促進し、持続可能な企業成長を可能にする一助となるでしょう。

プロフィール

-

西野 浩明のポートレート 西野 浩明

関西システムコンサルティング部長

2001年、NRIに入社。15年超のシステム開発経験・プロジェクトマネジメント経験を活かして、ビジネス変革・業務改革を伴うシステム上流工程(構想、計画、システム調達)、インフラ構想(クラウド活用戦略、アーキテクチャーデザイン)、システム開発時のユーザー側活動(要件定義、開発標準化、業務移行、受入テスト)および大規模システムPMOなどのITコンサルティングに従事。

※組織名、職名は現在と異なる場合があります。