ITマネジメントコンサルティング部 高木 大輔、高橋 未鈴

AIの活用が企業活動に急速に広がる一方で、ガバナンスが追いつかないケースも少なくありません。便利さの裏側に潜むリスクは、従来のITとは性質が異なり、ひとたび顕在化すれば企業経営の致命傷になり得ます。欧州AI法(EU AI Act)をはじめとしたグローバル大での規制強化への対応も迫られるなかで、日本企業は、AIガバナンスとどう向き合うべきなのでしょうか。

野村総合研究所(NRI)で、AIガバナンス構築を支援する高木大輔と高橋未鈴は、経営層自らが「AI CoE(センター・オブ・エクセレンス)」などの組織づくりを主導し、推進と統制を両立させる「攻めのガバナンス」への転換が必要であると提言します。

「知らなかった」では済まされない、AIが突きつける新たな経営責任

――説明責任が強く問われる時代に、ガバナンスが追いつかない状況でAI活用が進むことで、企業はどのようなリスクに直面しているのでしょうか。

高木 : AIが様々な事業や業務に入り込むことで、経営上のリスクはこれまで以上に拡大しています。ハルシネーションによる誤情報の発信や、予期せぬ権利侵害(著作権侵害等)、AIを狙ったサイバー攻撃(プロンプトインジェクション、モデル窃取、データポイズニング等)など、多岐にわたります。業種によっては、人命に影響を及ぼす可能性もあり、従来のITリスクより経営への影響はさらに大きくなっています。

――AIならではのリスクは、どこにあるのでしょうか。

高木 : AIはブラックボックス性が高く、「何が、なぜ、どう判断されたか」を説明しづらい点が特徴です。また、一度誤った判断ロジックや不適切なデータが入りこむと、企業の意思決定や顧客対応等のあらゆる場面に影響します。単発のシステム障害ではなく、「企業としての判断の質」そのものが疑われる事態になりかねません。

高橋 : 従来のITと同じ感覚でAIを捉えていると、「そこまでのリスクはないだろう」と判断してしまいがちです。しかし、AI活用が進むほど、経営として「どこで、何が、どのように使われているのか」を把握できていない状態は許されません。説明責任が強く問われる時代において、ガバナンス未整備のままAIを使うこと自体が、大きな経営リスクになります。

経営と現場をつなぎ、守るべき領域を戦略的に絞り込む

――進化する技術に対してどこまでリスクを許容すべきか経営として判断が難しくなっている企業も少なくありません。現場では、どのような状況が起きているのでしょうか。

高橋 : 二つの極端な状況が同時に起きています。一つは、使い方に関するルールや相談先が定まらず、リスク認識が曖昧なまま現場判断での利用が先行し、シャドーAI化してしまっているケースです。もう一つは、上層部がAIのリスクを恐れすぎるあまり、ルールをガチガチに固めてしまい、現場で使われなくなるケースです。この両極端が多くの企業で併存しています。

――AIガバナンスを「使わせないためのルール」と誤解する企業もありそうです。実際には、経営として何を決めることが重要なのでしょうか。

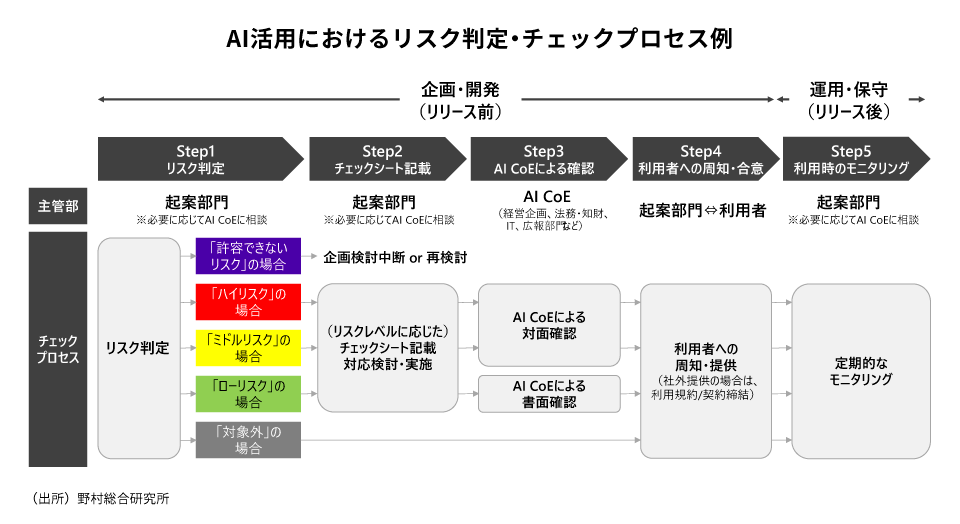

高木 : 重要なのは、AI活用を止めるだけでなく、安心して使うための前提を経営が決めることです。そのために、まずは業務・用途ごとのリスクを分類します。例えば、工場のラインや社会インフラを直接制御するようなものはハイリスク、対外的な情報発信に関するものはミドルリスク、議事録作成などの社内オフィス業務の効率化に関するものはローリスクといった形で分類します。そのうえで、各レベルに対してどこまでなら許容するのかというリスク許容度(許容範囲、必須のチェックや承認、監査・モニタリングの水準等)を定めます。これは現場の個別判断ではなく、経営が責任を持つべき意思決定です。経営層が覚悟を持ってこの線引きをしなければ、ガバナンスは形だけのものになってしまいます。

高橋 : トップが方針を明確に示すことで、現場も安心して動けるようになります。逆に、経営のメッセージが曖昧なままだと、現場は萎縮するか、自己判断で使うかのどちらかになりがちです。推進とリスク管理を両立させるためには、経営層のリーダーシップが欠かせません。

――AI活用を進めるアクセルと、リスクを抑えるブレーキを同時に設計するうえで、重視すべき点は何でしょうか。

高橋 : 企業の事業内容によってどこをハイリスクと分類すべきかは異なります。各社で定められているリスクマネジメント規定や事業の特色など、リスクへの影響を及ぼす判断軸を十分に議論した上で、ここまではスピードを優先し、ここからは対策が必要だという線を引く。そのバランスを継続的に取り続けることが求められます。

高木 : 守りのリスクだけでなく、AIを活用しないことによる機会損失も含めて考えることも重要です。AIを活用しない判断が、コスト構造や意思決定のスピード、顧客体験、競争力に将来どんな影響をもたらすのか。経営戦略と照らし合わせて、どこは迅速に試し、どこは統制を強めるのかを判断することが重要です。

経営判断を、現場で機能させるために

――経営としての判断を、現場で機能するガバナンスとして定着させるためには、どのような体制や対策が必要でしょうか。

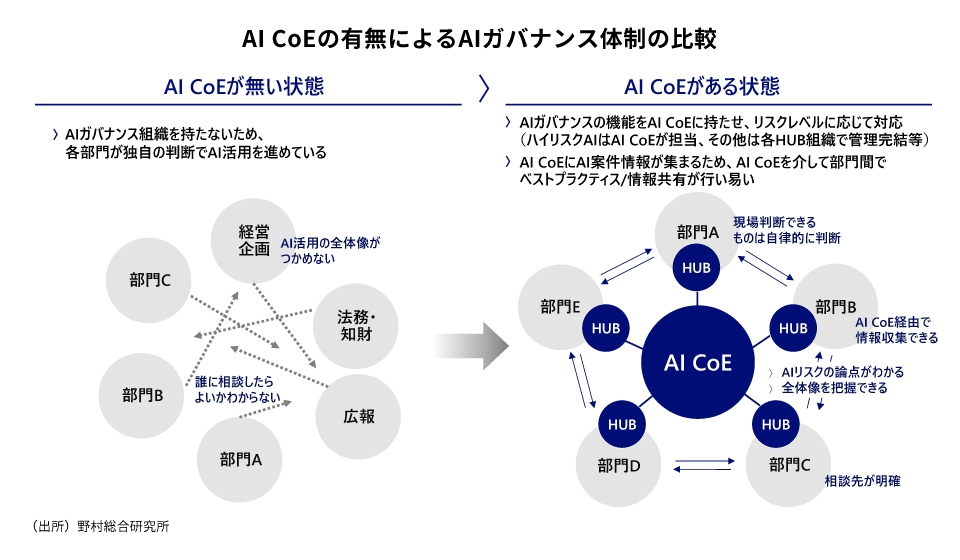

高橋 : まず重要なのは、「AI CoE(Center of Excellence)」という、組織横断型の司令塔を立ち上げることです。企業規模によっては専任組織でなくとも、その機能を持たせることが重要です。

これはIT部門だけで完結する話ではありません。法務、セキュリティ、そして事業部門のキーマンが集まり、「守り」と「攻め」の知見を一つのテーブルに集約する機能が必要です。現場が求めているのは、法律の条文のようなルールではなく、「自分の業務で具体的にどう使っていいか」という翻訳されたガイドラインです。AI CoEは、経営層が決定したリスク許容度を、現場が迷わず使える具体的なルールやツールに落とし込む変換機能を担います。さらに、この組織は警察のような監視役ではなく、現場の困りごとを解決する伴走者であるべきです。「この使い方はダメ」と却下するのではなく、「こうすれば安全にできる」という代替案を提示する。そうすることで、現場のナレッジがAI CoEに自然と集まり、結果としてガバナンスが形骸化せず、組織全体のAI活用能力(AIリテラシー)の底上げにつながっていきます。

高木 : 一方で、AI活用案件が増えていくと、すべてをAI CoEだけで見続けるのは現実的ではありません。各部門で自律的に判断できる人材を育てつつ、ガバナンスそのものも効率化していく必要があります。ハイリスクはAI CoEに相談し、ミドルリスク以下は各部門のHub組織で完結させるといった形を取れば、AI CoEの負荷を下げつつ、各現場で実効性のあるガバナンスを構築しやすくなります。

――AIガバナンスは、一度設計すれば終わり、というものではなさそうです。

高木 : AIの技術自体が非常に速いスピードで進化していますし、それに伴ってリスクの前提も変わり続けます。ガイドラインを一度作って安心するのではなく、運用しながら見直し、アップデートしていくことが前提になります。その延長線上で、今後はAIエージェントのように、AIが人の指示を待たずに自律的に動くケースも増えていくでしょう。そうなると、事前にすべてを想定した固定的なルールでは対応しきれない場面が出てきます。だからこそ、例外が生じたときにどう判断するのか、そのプロセス自体を設計しておくことが重要になります。

高橋 : 細かいルールを積み上げるよりも、判断の考え方や相談の流れを共有しておく方が、結果的に現場を助けることも多いと感じています。環境の変化に合わせて、柔軟に運用できるガバナンス体制が求められています。

――そうした変化の中で、経営層にはどのような姿勢が求められるのでしょうか。

高木 : 技術の進化を前提に、「完璧な形を最初から求めない」姿勢が重要です。運用しながら考え、必要に応じてアップデートしていく。その意思を経営層が示すことで、組織全体が動きやすくなります。

高橋 : AIを使わないという選択肢は、もはやありません。AIガバナンスの整備は守りのためだけでなく、攻めを支えるためのものです。その認識を経営層が明確に示すことで、現場が自ら判断し、動ける組織につながっていくと考えています。

プロフィール

-

高木 大輔のポートレート 高木 大輔

ITマネジメントコンサルティング部

2013年、慶應義塾大学大学院理工学研究科修士課程修了後、野村総合研究所に入社。

同年、NRIセキュアテクノロジーズへ出向し、セキュリティコンサルティングに従事。

2019年に出向解除後、デジタル/IT戦略、組織変革、人材育成、DX推進等、デジタル変革/ITマネジメント領域のコンサルティングに従事。 -

高橋 未鈴のポートレート 高橋 未鈴

ITマネジメントコンサルティング部

2009年野村総合研究所に入社。製造業・物流業のシステム開発、プロジェクトマネジメント、運用保守業務を経験。近年は幅広い業界を対象に、ITマネジメントコンサルティング業務に従事。専門分野は業務・システム変革構想、IT戦略、人材育成、ITガバナンス。

※組織名、職名は現在と異なる場合があります。