NRIセキュアテクノロジーズ 江藤 修、橘 和樹、荻莊 裕太

デジタル技術の進展により、IoTやAIの活用領域はサイバー空間から現実世界へと急速に広がりつつあります。宇宙空間を通信基盤として活用する「宇宙IoT」、そしてロボットや自動運転車のように物理的な現実世界で直接作用する「フィジカルAI」は、その象徴的な動きと言えるでしょう。

こうした変化は、新たな価値を生み出す一方で、セキュリティの前提そのものを大きく変えつつあります。ここでは、宇宙IoTとフィジカルAIという二つの潮流を取り上げ、IoT分野の専門家である江藤 修、橘 和樹と、フィジカルAI分野に関しては荻莊 裕太が、それぞれに求められるセキュリティ設計の考え方と課題を整理します。

宇宙IoT時代に求められるセキュリティ設計

地上では、遠隔監視・制御や災害時通信などを支えるIoTの活用が拡大しており、通信圏外を含む広域エリアでもネットワークに接続したいという需要が高まっています。こうしたニーズに応える手段として注目されているのが宇宙空間の活用です。近年は低軌道(LEO)衛星の普及により、小型衛星を多数連携させた通信ネットワークの構築が進み、宇宙空間は新たなIoT基盤として活用され始めています。

一方で、このような宇宙IoTの拡大に対し、セキュリティの整備は十分とは言えません。特に機器レベルでの包括的なセキュリティ要件や規制は未成熟であり、現状では、地上のIoT機器向け規格に加え、宇宙に関する研究機関や企業で運用されている先行事例を参照しながら、各事業者が個別に設計・運用を進めている段階にあり、利用の拡大に対して、セキュリティの枠組みが追いついていません。

こうした中で重要なのは、宇宙IoTのセキュリティを単に「宇宙か地上か」という切り分けで捉えるのではなく、システム全体として捉える視点です。実際の攻撃事例では、侵入口は地上のネットワークにあり、そこから衛星通信を経由して被害が拡大するケースが確認されています。また、宇宙側でも認証や暗号処理の不備が指摘されており、悪用された場合には衛星や探査機の制御に影響を及ぼす可能性があります。すなわち、宇宙IoTは、地上と宇宙が連続した一つのシステムとして捉え、その全体でリスクを管理する必要があります。

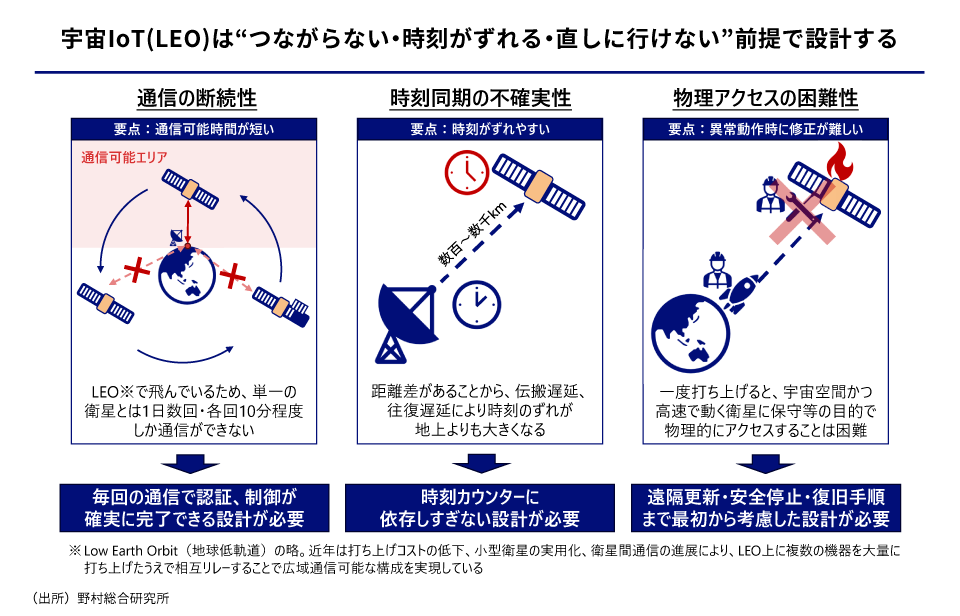

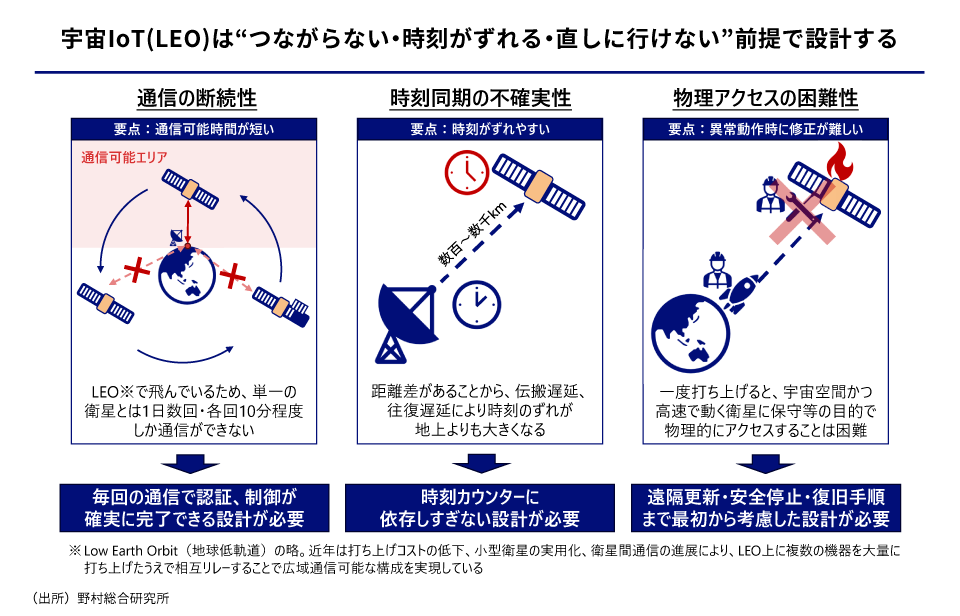

さらに重要となるのが、宇宙特有の制約に起因する設計上の難しさです。宇宙IoTでは、通信は常時確保されるものではなく、衛星の位置関係により断続的にしか接続できません。また、地上との距離に起因する遅延や時刻ずれにより、時刻同期の精度も保証されにくくなります。さらに、一度打ち上げた機器には物理的にアクセスできず、修理や交換が困難です。このため、「常につながるわけではない(通信断)」「時間がずれ得る(高遅延)」「すぐに修復できない(長期運用)」という前提での設計が必要です。

この前提に立つと、セキュリティ設計の考え方は大きく変わります。認証機能では、通信が確立された都度、相互認証と機器状態の検証(アテステーション)を確実に行い、その後は軽量な認証付き通信へ移行する構成が求められます。限られた通信時間の中で、安全性と効率性を両立させるためです。

また、ソフトウェア更新についても、通信断を前提とした設計が不可欠です。そのため、更新データは分割して送信し、断片ごとに真正性を検証できる仕組みが必要となります。さらに、更新が途中で失敗した場合でも、機器自身が安全な状態へ自律的に復旧できる設計も重要です。

このように、宇宙IoTのセキュリティは、従来の延長ではなく「制約を前提とした再設計」が本質となります。地上で培われた技術や規格を出発点としつつ、通信断や長期運用といった宇宙特有の条件に適合させて最適化することが欠かせません。

今後、宇宙IoTの利用がさらに拡大する中で、設計段階からセキュリティを組み込む「Security by Design」の重要性は一層高まります。宇宙と地上をまたぐ新たなインフラの安全性を確保するためにも、早い段階から統合的な視点での対策を講じていくことが求められます。

一方で、このような宇宙IoTの拡大に対し、セキュリティの整備は十分とは言えません。特に機器レベルでの包括的なセキュリティ要件や規制は未成熟であり、現状では、地上のIoT機器向け規格に加え、宇宙に関する研究機関や企業で運用されている先行事例を参照しながら、各事業者が個別に設計・運用を進めている段階にあり、利用の拡大に対して、セキュリティの枠組みが追いついていません。

こうした中で重要なのは、宇宙IoTのセキュリティを単に「宇宙か地上か」という切り分けで捉えるのではなく、システム全体として捉える視点です。実際の攻撃事例では、侵入口は地上のネットワークにあり、そこから衛星通信を経由して被害が拡大するケースが確認されています。また、宇宙側でも認証や暗号処理の不備が指摘されており、悪用された場合には衛星や探査機の制御に影響を及ぼす可能性があります。すなわち、宇宙IoTは、地上と宇宙が連続した一つのシステムとして捉え、その全体でリスクを管理する必要があります。

さらに重要となるのが、宇宙特有の制約に起因する設計上の難しさです。宇宙IoTでは、通信は常時確保されるものではなく、衛星の位置関係により断続的にしか接続できません。また、地上との距離に起因する遅延や時刻ずれにより、時刻同期の精度も保証されにくくなります。さらに、一度打ち上げた機器には物理的にアクセスできず、修理や交換が困難です。このため、「常につながるわけではない(通信断)」「時間がずれ得る(高遅延)」「すぐに修復できない(長期運用)」という前提での設計が必要です。

この前提に立つと、セキュリティ設計の考え方は大きく変わります。認証機能では、通信が確立された都度、相互認証と機器状態の検証(アテステーション)を確実に行い、その後は軽量な認証付き通信へ移行する構成が求められます。限られた通信時間の中で、安全性と効率性を両立させるためです。

また、ソフトウェア更新についても、通信断を前提とした設計が不可欠です。そのため、更新データは分割して送信し、断片ごとに真正性を検証できる仕組みが必要となります。さらに、更新が途中で失敗した場合でも、機器自身が安全な状態へ自律的に復旧できる設計も重要です。

このように、宇宙IoTのセキュリティは、従来の延長ではなく「制約を前提とした再設計」が本質となります。地上で培われた技術や規格を出発点としつつ、通信断や長期運用といった宇宙特有の条件に適合させて最適化することが欠かせません。

今後、宇宙IoTの利用がさらに拡大する中で、設計段階からセキュリティを組み込む「Security by Design」の重要性は一層高まります。宇宙と地上をまたぐ新たなインフラの安全性を確保するためにも、早い段階から統合的な視点での対策を講じていくことが求められます。

フィジカルAI時代に求められるセキュリティ設計の再定義

自動運転車や産業用ロボットのように、AIが現実世界で直接動作する状況が広がり始めています。これらに共通するのが「フィジカルAI」と呼ばれる領域です。フィジカルAIとは、センサーで環境を認識し、AIが判断した結果をアクチュエータを通じて物理的な動作として実行する技術を指します。従来のAIがサイバー空間での情報処理を中心としていたのに対し、現実世界に直接影響を及ぼす点が大きな特徴です。

この違いは、セキュリティの考え方にも大きな変化をもたらします。従来のAIでは、情報漏えいや不正アクセス、不正利用といった「情報の保護」が主な論点でした。一方、フィジカルAIでは誤動作や設備損傷、さらには人身事故といった「行動の安全」まで含めて考える必要があります。すなわち、リスクはサイバー空間にとどまらず、現実世界へ直接的に影響を及ぼす可能性があるのです。

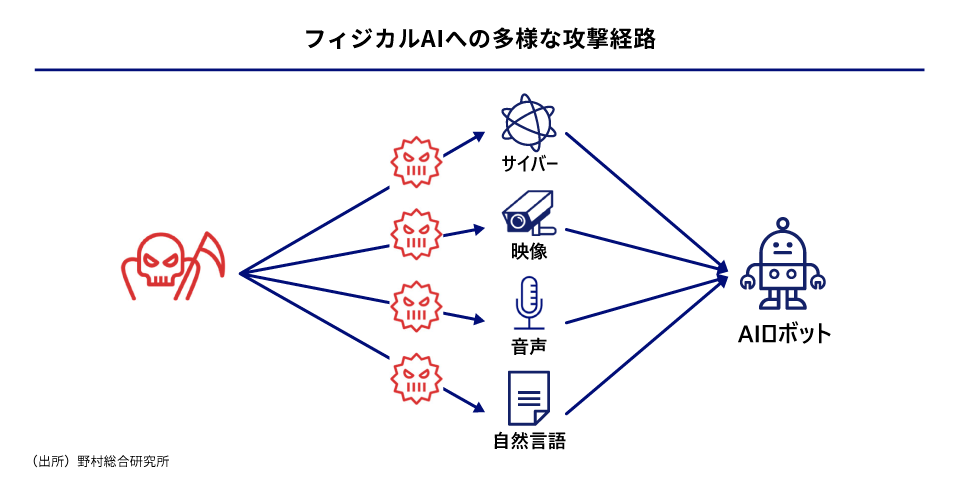

こうしたリスクの背景には、フィジカルAIの構造的な特徴があります。フィジカルAIは、センサー、AIモデル、通信、制御、アクチュエータといった複数の要素が連携して動作しており、そのいずれもが攻撃対象となり得ます。例えばセンサーに対する攻撃では、外部から偽の信号を与えることでAIに誤った環境認識をさせることが可能です。これにより誤判断が誘発され、動作停止や衝突などの被害につながるリスクがあります。さらに、判断の中枢であるAIモデルやソフトウェアに対しては、入力データをわずかに改変して誤判断を引き起こす敵対的攻撃や、学習データの改ざん、ソフトウェアの脆弱性を突いた侵入などが想定されます。加えて、通信経路への攻撃や不正なソフトウェア更新、アクチュエータの誤作動なども、物理的な被害に直結します。

また、人的要因も無視できません。AIへの過信による監視不足や、内部不正、運用体制の不備、理解不足といったリスクは、被害の拡大につながる可能性があります。フィジカルAIは人と密接に関わるため、人の関与そのものがセキュリティの一部となる点が特徴です。

このようにフィジカルAIは多層的なリスクを抱えており、単一の対策では十分とは言えません。そのため、セキュリティ確保にはシステム全体を見据えた統合的なアプローチが求められます。具体的には、技術・制度・社会の三つの観点からの対応が重要です。

技術面では、AIモデルの堅牢化や複数センサーの情報を組み合わせるセンサーフュージョン、リアルタイムの異常検知、フェイルセーフ設計などが挙げられます。これらを開発段階から組み込む「Security by Design」の考え方が不可欠です。制度面では、責任所在の明確化や標準化・認証制度の整備が求められます。さらに社会面では、AIの判断プロセスを説明できる仕組みや、利用者への教育・啓発を通じた理解の向上が重要となります。

フィジカルAIは現在、物流や製造といった限定的な環境から導入が進んでおり、今後はより多様な分野へと広がっていくと見込まれます。将来的には、人と協働するシステムとして社会に定着し、インフラの一部となる可能性もあります。その過程において、セキュリティは、個別の技術基盤から、社会全体の信頼を支える基盤へと位置づけが変化していくでしょう。

フィジカルAIのセキュリティは、情報保護の延長ではなく、「人と社会の安全」を前提とした新たな設計課題です。本格的な普及を見据え、今の段階から統合的な対策を講じていく必要があります。

プロフィール

-

江藤 修のポートレート 江藤 修

NRIセキュアテクノロジーズ

-

橘 和樹のポートレート 橘 和樹

NRIセキュアテクノロジーズ(NDIAS出向)

-

荻莊 裕太のポートレート 荻莊 裕太

NRIセキュアテクノロジーズ

※組織名、職名は現在と異なる場合があります。