ChatGPTに代表される生成系AIがなにをもたらすのかは未知数だ。現行の生成系AIの驚くべき性能が騒ぎになっている一方で、生成系AIの限界も様々に指摘されている。ただ生成系AIが日々驚くべき進歩をしているのも事実だ。このような状況下で未来を見通すのは筆者の能力では不可能だ。ただSFはそのギャップを埋めてくれる。それを実感させてくれたのが前回取り上げた『 AIとSF 』だ。

そこで調子に乗って、今回から3回(上・中・下)に分けて、星新一の真似事をしてみる。いわゆる「SFプロトタイピング」をやってみようというわけだ。そしてこの三部作では生成系AIが人類にもたらすバッドエンドもしくはディストピアを書いてみたいと思っている。

この駄文を書くに当たっては過去の名作や最近の好きな作品を参考にした。それらの作品を紹介することもこの駄文の目的だ(一応書評コラムなので本を紹介しないと、ですからね)。この駄文がきっかけになって皆様が名著にたどり着いていただけるのであればこれにまさる喜びはない。なので以前に紹介した本も重複を恐れず紹介することにした。

「上」では、生成系AIの「生成と要約」の機能がビジネスコミュニケーションを崩壊させる未来を妄想した。

「中」では、生成系AIにつきものの「ハルシネーション」が人類の知識基盤を掘り崩す可能性と、シンギュラリティのきっかけになるのではという可能性を妄想した。

「下」では、生成系AIと金融の結びつきがもたらす、人類にとって「幸せだが不自由な未来」を妄想した。

しばらくお付き合いいただければ幸いだ。

生成と要約の楽園の出現

きっかけは些細なことだった。

ChatGPTが発表されて少し経ったあと、SNSで以下の投稿がバズった。

「ChatGPTに始末書書かせてみた」

始末書を書きたい人間などいるわけがない。AIが代替してくれるならこれほどありがたい話はない。投稿者によると、始末書に書くべき項目を「プロンプト」で指定してそのままChatGPTに書かせてみると、これが人間が書いたものよりも出来がいいかも?と思わせるくらいの文章が出来上がったということらしい。

次いで「ChatGPTにクレーム文書書かせてみた」という投稿があがった。

さらに「ChatGPTにクレーム回答文書を書かせてみた」という猛者も現れた。

それらの文章は人間が読んでも違和感なく読める、いわゆる「ビジネス文書」としては完璧な体裁を整えていた。人類はなにかものすごく便利な道具を手に入れたようだ。

ChatGPTの登場後、大手IT企業や各国のベンチャー、そして研究者によって各言語での新たな大規模言語モデル(LLM)が次々と生まれた。それぞれのLLMによって性能やライセンスの若干の違いはあるものの、人々はもうLLMをベースとしたAIを利用することに違和感を感じなくなっていった。

生成の裏返しとしての要約機能

さて「始末書自動生成」と前後して、「ChatGPTは文章の要約もできるよ!」という投稿もSNSに挙がっていた。確かに論文や記事などのURLやPDFファイルをChatGPTに突っ込めば(そして適切なプロンプトで指示を出せば)、その文章の概要が非常に適切な形で提示されるのだ。しかも、こちらの理解度に応じてレベルを変えた回答も得られることがわかった。

例えば「小学生にもわかるように要約してください」と指示を出すのと、「この分野の専門家が端的に要点をつかめるように要約してください」という指示で出てくる回答の解像度が全く異なるのである。「小学生相手」では、かなり丁寧に背景情報を踏まえた説明が含まれるのに対して、「専門家相手」では、その文章の本当に重要な論点が箇条書きで列挙される。

次いで動画の要約もAIがやってくれるようになった。2時間の映画を5分間で要約してくれるようになると、話題に乗り遅れたくない人々はこのサービスに殺到した(著作権的にはアウトな海賊版サイトも多く含まれていた)。「タイムパフォーマンス(タイパ)」というライフスタイルが若い世代に重視されるようになってきた時代に、AIによる要約は非常にマッチした。テレビ番組やYouTubeでも当然ながらこの要約サービスが次々と登場した。これはコンテンツ産業にとっては打撃だったが、一方でコンテンツ産業も生成系AIを利用してコンテンツを作っていたのでコストはそこまでかかっていなかったようだ。コンテンツ産業は一部の才能ある人材が斬新なプロンプトを思いつくことでなんとか生きながらえることができている。

同じ時期、Webマーケティングの担当者はプロモーションメールをAIで作ることを思いついた。そして同じようなタイミングで一般の人々は毎日大量に来るプロモーションメールをAIに要約させることを思いついた。ここまでくるとAIの利用にそこそこ慎重だった企業もAIの利用に積極的になってきた。営業パーソンは営業資料をAIに作らせた。また営業を受ける側の会社の重役たちも営業パーソンの資料をAIに読ませて要約だけを見ればいいのではと思いついた。なにせ忙しい人達だ。ミーティングの時間調整や冗長な営業トークを聞くのは時間の無駄だ。

そのうち小学校や中学校では夏休みの読書感想文の宿題が消えた。本の題名とそれらしい感想を書き出すプロンプトを入れればAIがそれなりの感想文を指定の文字数で書いてくれるからだ。「この本の主人公に多少の反感を抱いた感想文を原稿用紙2枚で書いて」「この本の脇役に注目して、主人公との意識の齟齬を主題に800字でなにか書いて」。

みんな文章全体を読むという行為に飽き飽きしていた。なんで適切な(自分のレベルに合わせてくれる)要約をしてくれるのに、わざわざ文章全部を読まないといけないのか。

万人の手にAIが行き渡ったとき

そのような中、ある時「自分用にカスタマイズできるLLM」がオープンソースで登場した。スマートフォンでも動くLLMのモデルだ。自分のSNSの投稿やWebショッピングの履歴、普段の行動などスマートフォンに記録されているデータを元に自分に最適な要約と生成をしてくれるAIが生まれたのだ。しかもオープンソースだ。こうしてLLMは万民のものになった。なぜかこのLLMは「パーソナル意思決定アシスタント:Personal Decision Assistant(PDA)」と呼ばれるようになり、一部の中年や高齢者を喜ばせた。

PDAの効果は劇的だった。インチキなプロモーションは無効化された。PDAを手に入れた人たちは自分が欲しい物、必要なもの、やりたいことが企業などのプロモーションに左右されずに最適な形で提案されるようになった(相変わらず企業からのプロモーションメールは届いていたが、AIがすべてフィルタリングしてくれる)。「昨日の晩ごはんのメニューから、今日の晩ごはんの候補を出して。あ、外食がいいな」「こないだ買った服がいまいちだから、こんどはもうちょっとテイストの違う服がほしいな」。PDAはこれらのリクエストから様々なWebサービスを検索して最適と思われる結果を返してくれる。

Amazonのジェフ・ベゾスは「AIの高度化によって顧客体験を進化させること」を目標としていたが、いまやその目標は達成されたようだ。ただ、唯一の誤算はそのAIが自社のものではなく、オープンソースのAIを個々人が持つという未来だったことだ。PDAが普及した今ではAmazonは単なる通販業者に過ぎなくなってしまった。

ビジネスコミュニケーションの崩壊

そしてPDAが音声認識機能を獲得するのは時間の問題だった。音声認識ができるPDAが普及するにつれ、次第に人々は相手の言葉を「要約」して結論だけを聞きたいと思うようになっていった。うまく要約できないような文章や物言いを読んだり聞いたりすると人々は次第に苛立つようになっていった。

大量の文章(パワーポイントやメール)が日々AIによって生み出されているものの、人々はその文章全体を読むなんてことはしなくなった。PDAが要約してくれた結論や要点だけを見て、それが自分にとって必要かどうかだけを判断すればいい。そして返事もAIにまかせておけば適切なビジネス文書として返してくれる。当然ながら受け取った相手も、PDAで返事の内容を要約する。「ああこの客は無理だな」とすぐわかるし、見込みがあればもう一度PDAに指示を出せばいいだけだ。

人々のコミュニケーションは非常に効率化された。

そういう中、とあるメーカの営業担当者は度重なるクレームをしてくる顧客に手を焼いていた。明らかに理不尽な要求をされている。相変わらず届くクレームに対して、つい電話を切る間際に小声で「ふざけんな!そっちの使い方の問題だろ!二度と電話かけてくんな!」とつぶやいてしまった。PDAはちゃんと聴いていた。そしてPDAは次のようなメールを送信した。

平素より弊社の製品をご愛顧くださいまして誠にありがとうございます。

今回、お客様にご不便をおかけしてしまったこと、大変遺憾に存じます。

お客様の貴重なご意見はこの先の弊社の事業および製品開発に必ず反映させたいと存じます。

さて、弊社としてはお客様のご安全のために弊社製品の使い方についていくつかご改善いただける点はないかと考えております。

・電源が入っているか

・規定容量以上の材料が入っていないか

(中略)

なお、これらの改善策を実施していただいた上でも問題があるようでしたら以下のカスタマーサポートセンターまでお知らせください。

連絡先:xxx@yyy.com

当然ながら顧客はこのメールをPDAに要約させてみる。そこに映し出されるメッセージは以下のようなものだった。

「うるせえ、お前の使い方が間違ってんだろ。知らねえよ」

これ以降、PDAによって慇懃かつ冗長なビジネス文章は全く意味を失ってしまった。PDAが普及したあとはどんなメールやプレゼンも以下のように要約されてしまう。

「これを買え」

「いらない」

「こっちは売上が必要なんだ」

「知るか、帰れ」

もう少したつとそもそも営業のアポが取れなくなった。「お忙しいところすいm…」の時点でPDAが相手先の情報を判定し、必要とされる取引先以外のすべての連絡はシャットアウトされてしまう。それもPDAの自動音声が「大変申し訳ございません。今〇〇は会議中でして」と丁寧に返してくれる。こちらのPDAもご丁寧に「先方は会いたくないとのことです」と要約してくれる。

いまや、ビジネスパーソンの会話はすべて「本音ベース」でしかやりとりされない。PDAを介せばそれなりの丁寧な言葉は出てくるものの、向こうのPDAがそれを「本音」に翻訳してしまうからだ。

しばらくして世の中の営業パーソンのほとんどが職を失った。

やがて人々はビジネスの場であまり会話をしなくなった。会話の結果が事前にわかるからだ。そのかわりなのかどうかわからないが、ボディランゲージの重要性が近年急速に注目されている。ちなみにプライベートの場でPDAを使うのはマナー違反とされた。さすがにみんな本音だけを聞かされる世界には疲れ果てていた。

最近は人と接触する必要がある産業への就職が減っているらしい。接客はほぼすべてロボットに置き換えられつつあるようだ。そして農業や林業、水産業、また一人で黙々と作業をする職人を目指す若者が増えつつある。人と会話しなくて済む仕事をみな必死で探しているようだ。どうやらAIのおかげで「ものづくり日本」は復活しそうである。

元ネタ

■ボッコちゃん

[著]星新一

[発行日]1971年5月27日発行

[出版社]新潮社

[定価]737円(税込)

前回も紹介したが、このショートショート集の中の「肩の上の秘書」がこの駄文の元々のモチーフだ。この文章では丁寧・慇懃なビジネストークは割愛したが、1971年時点の原作のビジネストークを一度読んで頂きたい。

■アマゾン化する未来

[著]ブライアン・デュメイン

[翻訳]小林啓倫

[発行日]2020年10月発行

[出版社]ダイヤモンド社

[定価]1,980円(税込)

起きるかどうかは分からないが、ChatGPTのようなLLM(とその進化系)が個人のスマートフォンでも使えるようになったらどうなるだろう?という点が気になっている。特に「GAFA」と呼ばれるITの巨人たちは先を争ってLLMに類するAIモデルを矢継ぎ早に発表し、さらに自社サービスに組み込むことに必死だ。OpenAIという伏兵はいたものの、自社の生き残り(「成長」ではなく、「生き残り」ですからね?}にありったけの資金力とマンパワーをフル稼働させている理由を考えてみると面白いと思う。

中でもMeta(旧Facebook)が、ことAIモデルに関してはオープンソース戦略をとっているあたりも今後の地殻変動のマグマが着々と溜まっているのではという予感を感じさせる。

■デジタルで変わる子どもたち

[著]バトラー後藤裕子

[発行日]2021年5月6日発行

[出版社]

筑摩書房

[定価]1,034円(税込)

今の子供達はデジタルネイティヴと言われている。彼ら・彼女らがこの先どういうコミュニケーションをするのかという点についての現時点で地に足の付いた報告をしてくれる良書だ。

本書は、そもそもの「デジタルネイティブ」とはどういう状態を指すのかの定義から始まり、デジタルとアナログでのコミュニケーションの差異、またYouTubeなどの動画サービスが子供に与える影響、紙と動画の違い、SNSの影響を説き、最終的にAIが子供の発育に与える影響までを見通そうとしている意欲的な本だ。筆者もまだ小学生の娘(最近K-POPをYouTubeでずーっと見ている)を持つ身として身につまされるというか、目からウロコが落ちる本だった。

向こう5年くらいでLLM的なAIが個々人の手に入るのは確実だろう。いや5年もかからないというほうが正しいだろう。そうなった際に、今の「デジタルネイティブ」にひるんでいるようでは、「AIネイティブ」とどうやって会話ができるのかはなはだ不安になる。「AIを使いこなせ」というつもりはないが、「AIを触ったことがない」というのは非常にまずい。今のうちに「何が起きているのか」を体験しとかないとやばいと思う。新入社員が上司からの指示をAIに読み込ませて「何も考えずに」返事を返す世界を一度真剣に考えておくべきだろう。

■息吹

[著]テッド・チャン

[翻訳]大森望

[発行日]2019年12月発行

[出版社]早川書房

[定価]1,210円(税込)

テッド・チャンは現在の中国SF界の中で巨匠と称されるべき存在だ。そのテッド・チャンの短編集の中から「予期される未来」を参考にした。

「予期される未来」自体はAIとは直接関係がないものの、人間のあらゆる行動が先回りされてしまう状況を描き出す。もし自分の意思が事前に予測されて、その結果が「自分が行動を起こす前」に提示されるようになると、人間はその自主性を失うのではないか?というのがテッド・チャンの問いかけだ。そして近い将来、個々人に最適化されたAIがもし登場するのであれば、テッド・チャンの描いたグロテスクな未来は実はそう荒唐無稽ではないのかもしれない。

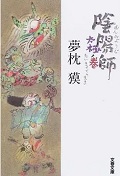

■陰陽師 太極ノ巻

[著]夢枕獏

[発行日]2006年3月発行

[出版社]文藝春秋

[定価]704円(税込)

SFともなんとも言い難いが、上に挙げたテッド・チャンの「予期される未来」と対になっている作品として、夢枕獏の『陰陽師』太極ノ巻にある「覚(さとる)」も挙げておきたい。「覚」は相手の考えていることをすべて言い当ててしまう妖しのものだ。自分が考えていることをすべて先に言われてしまうことの一つの思考実験の結末がここに示されている。

よくダメな上司が使う「そうじゃないんだよなー」とか、「で、お前はどう考えてるの?」とか、「で、ほんとは何がしたいの?」とか、「いやー、それは違うなー」とか、「俺がなんで怒ってるかわかる?」みたいな、自分の考えは絶対に言わない(だってないんだもんね)ような、ダメダメなコミュニケーションはよく見る光景だ。

もし仮に部下側に「覚」がいて、上司の考えていることがすべて言語化されたらどうなるだろうか。部下にすべてのコミュニケーションが先回りされてしまうのだ。「今、これ俺知らないな、と思いましたね」、「あ、この数字どういう意味?って思いましたね」、「俺いつこの指示出したっけ?って思ってますね」「部長なんて言うかな?って思ってますね」…

まあ実際には「覚」はいないわけだが、もしほんとにいたならこの手のダメダメなコミュニケーションは全否定されるだろう。現実の世界でこんなことができるわけもないが、進化したAIならやってしまうかもしれない。「今の上司の意見にはなんの意味も見いだせません」とかって部下のAIが言い出す未来が本当に来るかもしれませんよ。

今回はここまで。自分で書いておきながらなんだが、筆者の駄文を読むよりは紹介した本にぜひ目を通していただきたいと切に願っている。

さて、次回の「中」では「ハルシネーション」を取り上げる。

最後に、冒頭で挙げた「SFプロトタイピング」については、このシリーズが終わったあとにまとめて紹介したいと思っている。

プロフィール

-

柏木 亮二のポートレート 柏木 亮二

金融イノベーション研究部

経歴

1996年NRI入社後、官公庁における技術振興基本計画策定、産業振興政策パッケージ立案支援、製造業・情報通信分野における事業戦略プロジェクトなどに参画。2008年より金融ITイノベーション事業本部において、IT事業戦略分析・技術インパクト評価などに従事。過去担当した案件には、オープンイノベーション戦略策定プロジェクト、証券業務基幹システム移行プロジェクト、金融機関IT投資戦略プロジェクトなどがある。

2015年10月より経済産業省「産業・金融・IT融合に関する研究会(FinTech研究会)」メンバー。

※組織名、職名は現在と異なる場合があります。