執筆者プロフィール

ITアーキテクチャーコンサルティング部 小谷 真弘:

2011年、NRIに入社。金融系基幹システムの新規構築・エンハンス・会社合併に伴うシステム統合を経験。2017年より、新規事業計画策定、システム化構想やAI等を活用した業務改革支援、PMO支援などのコンサルティング業務に従事。専門は、デジタルを活用した事業変革や新事業創出、デジタル/IT戦略、業務改革実行。

企業におけるAI活用プロジェクトの増加と失敗

野村総合研究所 ITアーキテクチャーコンサルティング部の小谷です。主に製造業・流通業・小売業領域でデジタル技術を活用した業務改革・新規事業創出の活動を行っています。

近年のAI技術の進化とともに、事業計画にAI活用を組み入れる企業が増えています。一方、AIを導入してみたものの、目標を達成できず、導入に失敗しているケースも少なくありません。それは、AIの特性である「不確実性」を考慮していないためです。

今回は、業務改革や新事業創出のためのAI活用プロジェクトにおいて、AIの不確実性のために起こりがちな失敗を取り上げ、それを避けるための対策をお話しします。AI活用プロジェクトを担当している方をはじめ、経営層を含むマネージャー層の方々にも読んでいただければ幸いです。

AI活用プロジェクトでよくある失敗と対策

従来のシステムは決められたアルゴリズムに基づいて想定通りの「正解」を出しますが、AIを用いたシステムは学習させるデータによって異なる結果を出すという「不確実性」が存在します。そのため、「やってみないとわからない」という側面があり、適切なタイミングでこの不確実性に対処する必要があります。

AI活用のプロセスを、「コンセプト企画」「PoC(概念実証)」「実用化」「リリース後」の4つの段階に分けて、よくある失敗とそれを避けるための対策を説明します。

1.コンセプト設計における失敗

「AIを導入することが目的化していませんか?」

実際の業務にAIを試験的に導入したものの、思うように効果が出ず、プロジェクトは途中で頓挫し、実用化には至らなかったというケースがあります。このタイプの失敗は、AIの技術的な問題による場合もありますが、コンセプト企画の段階でAIをどの業務に適用して、どういう効果を目指すか、という目的設定を十分に検討しなかった場合に起こりがちです。

AIの導入はビジネス課題解決の手段です。しかし時に手段と目的が逆転して、AI導入自体が目的化してしまうことがあります。AI活用が適さない課題に当てはめようとしても効果は期待できません。AIが出す結果には「不確実性」があるため、定型的な経理業務など、決まった処理と正確な結果が求められる業務には向いていませんし、通常のシステムで実現した方が確実で効率的な場合も多いです。一方で、AIは人間や通常のプログラミング手法では解決が難しい複雑な問題を解くのが得意です。AIの得意不得意を見極めて、導入のコンセプトを考えることが重要です。

他社がやっているから自社でもやってみよう、という安易な考えで取り掛かるのではなく、なぜAIが必要なのか、どの課題を解決できるのかを、この最初の段階で十分に検討することが重要です。

2.PoCにおける失敗

「学習データの"量"だけに着目していませんか?」

PoCで、準備したデータで学習させたAIを試験的に現場に使ってもらったところ、結果の品質が悪く、現場からは「使い物にならない」というクレームが殺到し、実用化が見送られたケースがあります。このタイプの失敗は、AIは学習データによってその振る舞いが変わる「不確実性」に起因するもので、データの質や量が不十分であった場合、出来上がるAIモデルの品質も悪くなるからです。

PoCでは、課題解決に役立つ質の高いデータを用意できるかが重要となります。同じようなデータばかり学習させてもAIの精度は向上しません。エンジニアと協力して、事前にAIの動作範囲を定義し、訓練の目的に合った適切な訓練・テスト用データの設計が必要です。そして、手書き書類や画像・映像データなどはAIが読める形に変換して、学習用データを準備します。

品質の高いデータとは、被覆性、均一性、妥当性の3つの要素を満たすデータのことです。(産業技術研究所「機械学習品質マネジメントガイドライン」による)

- 被覆性: 対応すべき状況の組合せに対して、状況の抜け漏れがなく、十分なデータが含まれること

- 均一性: データセット内の各状況や各ケースが、入力されるデータ全体における発生頻度に応じて抽出されていること

- 妥当性: データセット中の各データが訓練の目的に照らして妥当であること

- データセットとはAIが学習を行う際に必要な学習データのことで、データとデータに対するラベルをセットにしたもの

実用化段階ではさらに多くの学習データが必要となるため、データの入手方法について、PoCの段階から考えておく必要があります。

AIの不確実性を極力抑え、結果の精度を高めるためには、学習データの整備が最も重要です。AIの導入だけに目を向けるのではなく、データの特定、収集、変換、蓄積、廃棄を通じたデータマネジメントの確立とデータ基盤の整備に取り組むべきでしょう。

「AIの精度は高いほど良いと考えていませんか?」

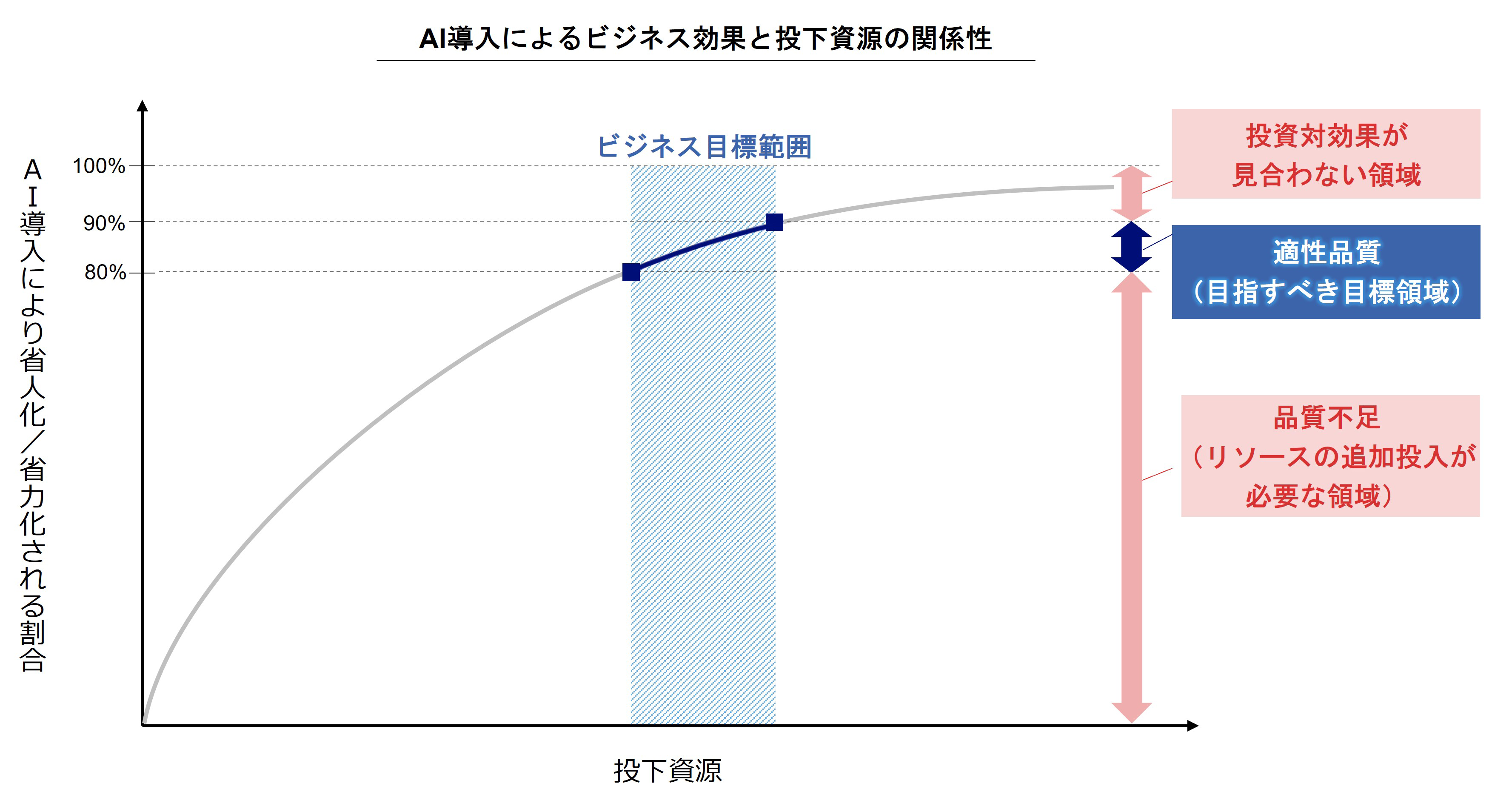

PoCにおける失敗はもう1つあります。AIの導入には成功しても、そこから得られる効果より、投資や運用コストが膨らんでしまい、費用が原因でAI活用を続けられなくなってしまったというケースがあります。このタイプの失敗は、現在のAI技術では100%の正解を保証できないにもかかわらず、AIに完全を求めてしまったことが原因の場合もあります。つまり、AIの精度は高ければ高いほど良いと考えて、必要以上に費用をかけすぎてしまうということが起こりがちです。

AIには「不確実性」があるので、実際にやってみないと、どのくらいの費用をかければどの程度の効果が出るのかがわからないという面があります。一般的に、AIの精度が向上するにつれて、それを高めるために必要な費用や労力(投下資源)は増えていき、割に合わなくなってくる傾向があります。そのため、100%の精度を目指すのではなく、合理的な目標を設定すべきです。そうしないと、やめどきを見失ってしまいます。

では、AIの精度をどのように設定したらいいでしょうか。目標に対して最低限必要なAIの正解率である「下限」を設定するだけではなく、これ以上精度を高めても費用が効果を上回ってしまう精度を「上限」として設定するのがよいでしょう。例えば、AI導入によって20%の省力化を目標とした場合、それを実現できるだけの精度(80%)を下限とし、投下資源が省力化効果を上回る精度(90%)を上限とします。

AIでビジネスの課題を解決しようとする場合、PoCの段階で、AIの実現性・実用性の検証に加えて、費用対効果を算定しておくことが重要です。

3.実用化における失敗

「AI単体での課題解決しようとしていませんか?」

AIを現場に導入したものの、結果にばらつきがあったり、不正確な結果が出る場合もあったため、結局人間がAIの結果を確認し、修正しなければならず、却って手間がかかったり、業務の品質が落ちてしまったりというケースがみられます。このタイプの失敗は、AIの「不確実性」のために不得意な作業があるにもかかわらず、業務を完全にAIに置き換えようとした場合に起こりがちです。

AIには、通常プログラムのように予め出力結果を予見できるアルゴリズムがあるわけではなく、100%の正解は出せないうえに、どう処理したかはブラックボックスになっています。(近年、XAI〔Explainable AI〕製品も登場し注目されていますが利用事例はまだ少ない)

開発者の想定外の結果が起こっても、なぜそのような結果になったのかを特定できないため、適切な改修が難しい。結局、AIの結果を人間が評価・判断する必要が出てきます。

AIと人間にはそれぞれ得意不得意があります。AIだけ、人間だけで問題を解決しようとせずに、AIと人間を組み合わせた業務プロセス設計(最適化)を行う必要があります。特に、重大な問題の発生が想定される業務においては、AIと人間の役割分担が重要になります。例えば、自動運転ではAIが対応できない走行環境下では運転者に運転を引き継ぐ仕組みが実装されています。AIを適用する対象の特性を理解し、AIに権限を委譲する領域と引き続き人間が対応する領域を上手く仕分けることで、「やってみないとわからない」領域が限定され、不確実性を減らすことが可能となります。

4.リリース後にも待ち受ける失敗

「AIを導入した後、そのまま使い続けていませんか?」

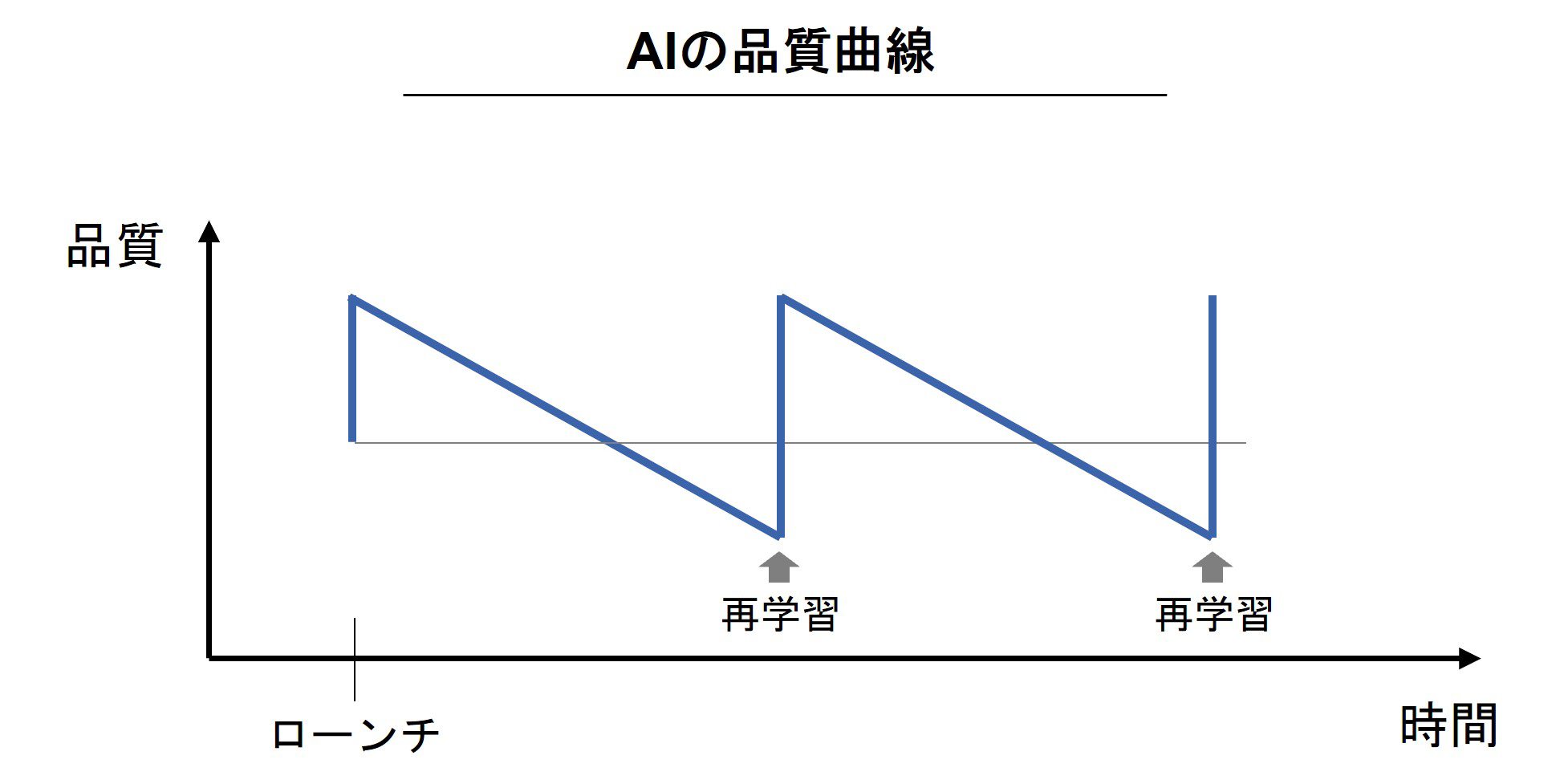

リリース当時のAIモデルをそのまま使い続けた結果、環境の変化に追従できず、結果の品質が低下してしまったというケースがあります。このタイプの失敗は、事業を取り巻く環境が変わったにも関わらず、古いデータで学習・最適化されたAIモデルを使い続けていたことが原因です。

AIモデルはデータによって振る舞いや精度が変化するという「不確実性」があります。古いデータで学習したモデルは古い結果を、新しいデータで学習したモデルは新しい結果を出してきます。そのため、一定基準以上の品質を確保するための仕組み(MLOps:Machine Learning Operations)が必要になります。

そのため、AIモデルを常に最適なパフォーマンスを発揮するように、そのパフォーマンスを定期的に監視し、必要に応じて再学習や更新を行う必要があります。

AI活用には、事業化リスクへの対処が重要

AIには想定外の振る舞いをするという「不確実性」があります。この不確実性は、事業において重大なリスクとなります。AIの振る舞いを人間が完全にコントロールできないため、事故などの問題が生じる場合があります。AIは非常に有効な技術ですが、人間はそのリスクを最小化するための対策が必要となります。

問題が起こった場合、正確な原因が分からなくても、責任は人間がとらなくてはなりません。しかし、その責任の所在はあいまいです。例えば、自動運転車で事故が起こった場合、責任は、運転者、所有する企業、自動車メーカー、AIを作った企業のいずれにあるのかが、自動化のレベルによって異なってくるからです。

今後、AIが社会に浸透していけば、AIが個人情報を勝手に収集してプライバシーを侵害してしまったり、特定のグループや人に不利益を与えてしまうというリスクも考えられます。

AIを事業に活用する場合には、このような事業リスクを理解した上で、本当にリスクを受け入れる価値のある事業なのか、そしてリスクをどのようにコントロールするのかについて、技術の進歩や世論を踏まえて考え続けなければなりません。しかし、AIの不確実性に起因するリスクを適切にコントロールすることができれば、AIを活用した事業創出や業務改革を実現することができるでしょう。

NRIでは、AIを用いた事業変革・ビジネス活用に関して、コンサルティングサービスをご用意しています。AIの業務改革・ビジネス活用などでなにかお困りの際は、ぜひご相談ください。

プロフィール

-

小谷 真弘のポートレート 小谷 真弘

サービスデザインコンサルティング部

2011年、野村総合研究所に入社。金融系基幹システムの新規構築・エンハンス・会社合併に伴うシステム統合を経験。2017年より、新規事業計画策定、システム化構想やAI等を活用した業務改革支援、PMO支援などのコンサルティング業務に従事

※組織名、職名は現在と異なる場合があります。