2025年12月5日 日刊工業新聞 掲載

日本企業のCIO(最高情報責任者)や、それに準じる役職者を対象にNRIが実施した9月調査(517社)でAI(人工知能)導入済みと回答した企業は約58%となり2023年度の約34%、24年度の約45%から増加し、AIは企業競争力を左右する不可欠な技術となりつつある。ただ情報漏洩やハルシネーション(誤情報生成)、権利侵害などリスクも顕在化。AIが原因のインシデントは増加傾向にあり、国内でも2025年にAI生成物に関する著作権法違反事案が発生した。その一背景として、定義した要件通りに開発されたか検証できる従来のシステム開発と異なり、AIは事前に検証できないことが多いという違いがある。適切にAIリスクをマネジメントし、AI活用の効果を最大化するAIガバナンスの重要性が増している。

責任あるAI

欧州連合(EU)では2024年8月、AIを規制する法案(欧州AI規制法)が発効し、リスクレベルに応じて制裁金を含む厳格な規制を段階的に適用するとした。米国でも州レベルではハードロー化が進展する動きが見られる。日本では2024年4月、総務省・経産省が「AI事業者ガイドライン」を策定し、また25年5月にAI推進法が成立し、AI利活用上留意すべき指針が示されたが、各事業者の主体的な取り組みに委ねられている。

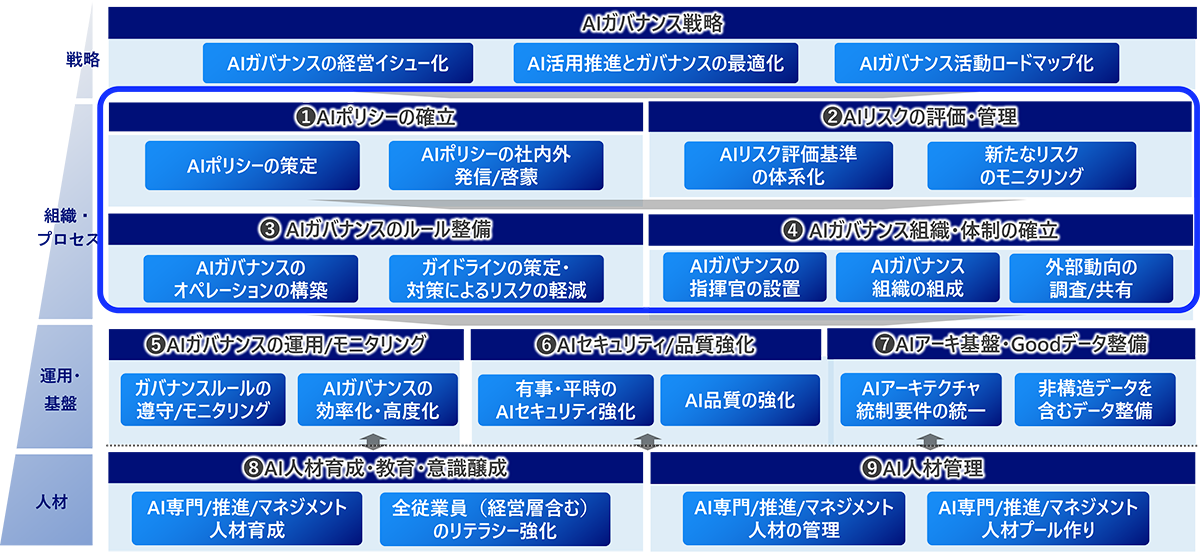

こうした国内外の動向を踏まえ、企業はどのようにAIガバナンスを確立すべきか。図1の通り、AIガバナンスを構築する初期の段階では、①―④の活動が主軸となる。

【図1 企業に求められるAIガバナンスの全体像(仮説)】

出典)筆者作成

まず企業におけるAI活用・リスクに対して重視する観点を掲げた①AIポリシーを策定する。従業員のAIリスクの認識や、外部ステークホルダーに対してAIを安全に利用する企業として、AIポリシーを発信。次に②AIリスクの評価体系を確立させる。リスク顕在化時の事業へのインパクトなどを参考にしながら、AIのリスクレベルをハイリスク・ミドルリスク・ローリスクなどに分類する考え方を確立させる。例えば欧州製薬企業では、当該AIのユースケースに対して人の健康や生命に影響を及ぼすリスク、レピュテーション(評判)、法的リスク、患者などへのプライバシーリスクなど10程度のリスクカテゴリを定義。各リスクを管掌する社内ステークホルダーが発生確率等を踏まえて優先順位を設定するといったAIのリスクレベル評価のフレームワークを構築しているという。その上で③AIガバナンスに関するオペレーションを確立する。リスクレベルに応じて濃淡を付けた対策をガイドライン化し、既存のセキュリティ規定などと整合させながらリスクチェックプロセスを確立。そして④これらのガバナンスを回すためのAIガバナンス体制を整備する。一連のAIのチェックプロセスで、どの組織が何をチェックするかの体制をつまびらかにすることが求められる。

リスク統制、段階的に強化

AIガバナンスの土台となるプロセスやガイドラインの整備後は、AIのモニタリング体制の確立ならびにリスク評価の効率化、セキュリティ・品質に係るソリューションの導入といった運用高度化への取り組みが必要となる。欧州製造業ではAIの企画から開発・デプロイ(展開・配備)・運用までのライフサイクル全体にわたってサードパーティーの複数のツールや内製のシステムを組み合わせながら、デプロイ前のモデルの精度やロバスト(堅牢)性の検証、欧州AI規制法などの関連法規との適合性検証、挙動のモニタリング(バイアスなどの検出)などを実施している。

AIの出力は入力・学習データや確率的な要素に加え、タイミングによっても変化し得るため、開発段階だけではなく導入後の運用も含めたライフサイクル全体にわたって評価・管理していくべきである。

さらに、長期的にはAIリスクのマネジメントだけではなく、企業全体のAI活用を最適化させる活動も重要だ。

企業のAIの管理対象が増加すると、似て非なるAIが異なる部門で開発されてしまう二重投資も起こり得る。そのため各部門のAIに関連する案件や取り組みをAI CoE(AI Center of Excellence)などに集約し、資源配分の最適化とリスク管理の一元化といった全体最適化への取り組みも求められる。その上で、全社横断でのAI共通基盤の整備および複数のAIモデルの統一的な管理・統制機能の具備や、AIが扱いやすい形式でのデータ整備、経営層を含めた従業員のAIリスクリテラシー強化・人材管理なども併せて行うことが望ましい。

全体最適に向け組織モデル変革を

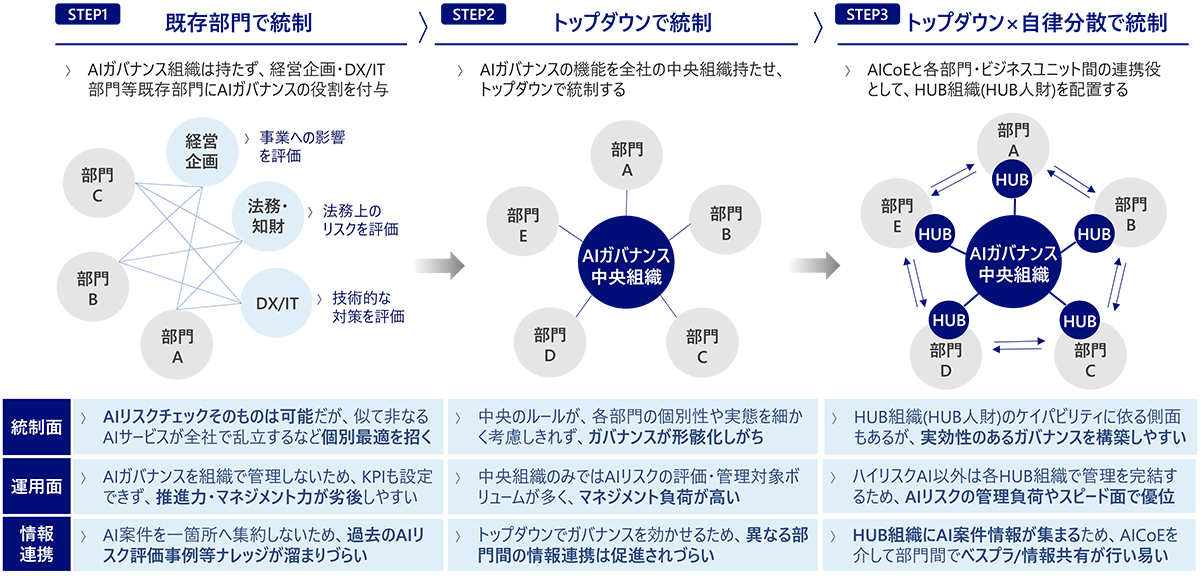

AIガバナンスの活動として取り組むべき事項を進めながら、ガバナンスの運用が形骸化する課題も頻繁に耳にする。図1④で示したAIガバナンス組織体制に課題があり、③で示したガイドラインなどルールが実効性に欠けてしまうことが、その主要因となっていると言える。具体的には、AIガバナンス組織の成熟ステップごとに、その課題を図2で説明する。

【図2 AI CoE組織変革パターン(仮説)】

出典)筆者作成

STEP1のAIガバナンス取り組み初期は、DX部門やIT部門など既存部門にAIガバナンスの役割を与えて図1の①―④の検討を進めることが多い。この場合、AIのリスクチェックそのものは可能だが、AIガバナンスを統括する中央組織が不在のため、各部門に類似のAIサービス開発が起こるなどの個別最適を招いたり、ナレッジがたまりにくいなどの課題が生じる。そこでSTEP2として、AIガバナンスの中央組織を設立し、トップダウンでマネジメントすることが多い。このケースではAI案件がAIガバナンス組織に集約され、AIリスクを一元的に管理できる利点がある。しかし一つの小規模な中央組織だけで、図1の①―④の検討を進めるのは一筋縄ではいかない。AI案件数が増大し利活用が進展するにつれ、中央組織によるトップダウンのガバナンス体制では限界が生じる。複数部門からのAI導入のリクエストが多くなることで、中央だけでは管理しきれない点、リスク評価の考え方が各部門の業務特性や実態を考慮できておらず各部門にルールが浸透せぬまま形骸化する点などから、全社で統制が取れない課題に陥ることが多い。

この場合、STEP3としてトップダウン×自律分散型のガバナンス体制を目指すことが得策である。各部門の業務特性を踏まえたAIガバナンスの標準を確立しつつ、中央の管理負荷も分散させ、各部門に固有の”AIガバナンス中央組織との連携部隊(HUB組織)”を組み込むマネジメント体制をとる。HUB組織の担当者は、AIガバナンス中央組織からAIのリスクチェックの権限を一部委譲され、ハイリスク以外のケースについては管轄する部門内でチェックを完結、ハイリスクの場合のみAIガバナンス中央組織へエスカレーションするなどリスクに応じたチェック体制を構築することで、各現場と中央組織が連携しながら実効性のあるAIガバナンス体制を構築することが有効であろう。

「経営アジェンダ」として推進を

企業におけるAIの導入業務範囲が拡大し、かつAIエージェントなどの技術進化も日進月歩で進むことから、AIリスクは今後さらに多様化していくと考えられる。AIガバナンスの推進を加速させるには、本紙で述べた活動に加え、経営層自身もAIガバナンスに対し強くコミットメントすることが求められる。経営層の責任として企業価値に直結していくものとしてAIガバナンスを経営アジェンダの中核の一つに位置付けながら推進することが望ましい。

プロフィール

-

金池 将司のポートレート 金池 将司

ITマネジメントコンサルティング部

大手金融機関を経て野村総合研究所へ入社。AIガバナンス構築・AICoE組織構想・生成AIユースケース探索・適用支援といった、AIマネジメント領域に関して戦略から実行までさまざまな業界へのコンサルティングを支援する。

※組織名、職名は現在と異なる場合があります。